Torek, 17. 7. 2018, 15.45

7 let, 4 mesece

Alarm pri Facebooku: po novem razkritju grozi še en škandal?

Danes zvečer bo britanska televizija Channel 4 predvajala novo epizodo oddaje Dispatches, v kateri razkrivajo ozadje cenzuriranja objav na družbenem omrežju Facebook. Pod krinko se jim je uspelo udeležiti izobraževanja za moderatorje vsebin na Facebooku, kjer so ugotovili, da ti pogosto namenoma ne odstranjujejo objav, ki prikazujejo nasilje nad otroki in spodbujajo nestrpnost.

Dokumentarna oddaja z naslovom Znotraj Facebooka: Skrivnosti družbenega omrežja opozarja na velika in pogosta neskladja med delom moderatorjev, ki so na Facebooku pozorni na neprimerne vsebine, in Facebookovimi standardi skupnosti, ki določajo, katere vsebine so na družbenem omrežju dovoljene in katere ne, poročajo nekateri britanski mediji, ki so si oddajo že ogledali še pred današnjo premiero.

"Ekstremno nasilje, sovraštvo do muslimanov, rasizem, vse to je šlo skozi filtre"

Preiskovalni novinar britanske televizije Channel 4 se je pomešal med kandidate za moderatorje na Facebooku, ki prihajajo na izobraževanje v podjetje CPL Resources. To je v Dublinu na Irskem, kjer je tudi evropski sedež Facebooka, z družbenim omrežjem pa pri nadzoru vsebin sodeluje že od leta 2010.

Delo Facebookovih moderatorjev je, da objave, ki so jih zaradi domnevne neprimernosti prijavili uporabniki, pregledajo in jih izbrišejo, prezrejo ali pa označijo za občutljivo vsebino, kar pomeni, da jih ne more videti vsak. Tale posnetek, ki prikazuje moderatorja pri delu, je posnel novinar Channel 4. | Foto: Channel 4 / Posnetek zaslona

Delo Facebookovih moderatorjev je, da objave, ki so jih zaradi domnevne neprimernosti prijavili uporabniki, pregledajo in jih izbrišejo, prezrejo ali pa označijo za občutljivo vsebino, kar pomeni, da jih ne more videti vsak. Tale posnetek, ki prikazuje moderatorja pri delu, je posnel novinar Channel 4. | Foto: Channel 4 / Posnetek zaslona

Novinar pod krinko je ugotovil, da Facebookovi moderatorji objave, ki prikazujejo ekstremno nasilje, pozivajo k sovraštvu do pripadnikov določene religije ali pa spodbujajo rasizem, pogosto prezrejo oziroma se namenoma odločijo, da jih ne bodo odstranili.

Konkretna primera sta bila med uporabniki že velikokrat prijavljen nazoren videoposnetek, na katerem odrasel moški kruto pretepa dečka, in satirična slika deklice, ki jo nekdo utaplja, ker se je zaljubila v temnopoltega sošolca.

Vodstvo Facebooka se je po poročanju Channel 4 v obeh primerih strinjalo, da bi objavi moderatorji morali odstraniti, ker je šlo za prikazovanje nasilja oziroma spodbujanje sovraštva. Facebookovi standardi skupnosti oba prepovedujejo. | Foto: Channel 4 / Posnetek zaslona

Vodstvo Facebooka se je po poročanju Channel 4 v obeh primerih strinjalo, da bi objavi moderatorji morali odstraniti, ker je šlo za prikazovanje nasilja oziroma spodbujanje sovraštva. Facebookovi standardi skupnosti oba prepovedujejo. | Foto: Channel 4 / Posnetek zaslona

Preiskava Channel 4 je razkrila tudi, da so Facebookovi moderatorji pri miru pustili nekatere komentarje, katerih avtorji so migrantom iz muslimanskih držav grozili, naj se vrnejo nazaj domov. Če bi bili uperjeni neposredno proti muslimanom, ne specifično muslimanskim migrantom, pa bi komentarje morali odstraniti, je tankost črte, ki ločuje sovražni govor in dovoljene vsebine, razkril preiskovalec Channel 4.

Niso vedeli, s kom se pogovarjajo, in povedali, da je v ozadju denar

Eden od zaposlenih v podjetju CPL Resources je preiskovalnemu novinarju Channel 4 zaupal enega od glavnih razlogov, zakaj občasno dopuščajo objave z nasilno ali sovražno vsebino. "Če cenzura postane preveč temeljita, ljudi družbeno omrežje ne bo več zanimalo."

Drugi zaposleni je to dopolnil s pojasnilom, da "imajo ekstremni profili na Facebooku, predvsem skrajno desničarski, več svobode pri objavljanju neprimernih vsebin zato, ker jih pogosto spremlja ogromno uporabnikov. Več časa kot ti preživijo na strani, več oglaševalskega denarja kapne Facebooku v žep".

Stališče, da Facebooku namenoma ne izbriše vseh neprimernih vsebin, ker bi tako izgubil preveč denarja, je za Channel 4 zavzel tudi eden od prvih vlagateljev v družbeno omrežje Roger McNamee, ki je v zadnjem času postal eden od največjih Facebookovih kritikov.

Roger McNamee je Facebook glasno začel kritizirati v začetku tega leta malo pred tem, ko je izbruhnil škandal Cambridge Analytica. Več o tem preberite s klikom na to fotografijo.

Roger McNamee je Facebook glasno začel kritizirati v začetku tega leta malo pred tem, ko je izbruhnil škandal Cambridge Analytica. Več o tem preberite s klikom na to fotografijo.

Channel 4 je pred predvajanjem oddaje, ki razkriva ozadje moderiranja vsebin na Facebooku, družbenemu omrežju sicer ponudil priložnost, da komentira razkritja zaposlenih v podjetju CPL Resources in Rogerja McNameeja.

Pričakovano so se odzvali s pojasnilom, da ekstremne vsebine družbenemu omrežju ne prinesejo več prihodkov in da takšne objave delijo manjšine uporabnikov, ki Facebook izkoriščajo kot medij za širjenje svoje ideologije ali zgolj za lastno zabavo.

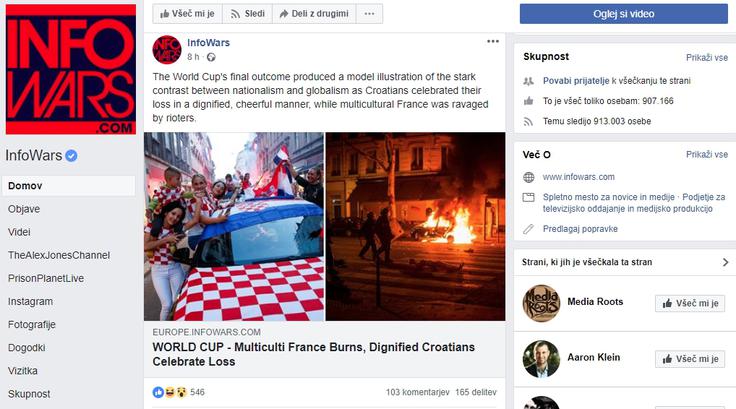

Facebook se je pod plazom kritik zaradi (ne)cenzuriranja vsebin sicer znašel že pretekli teden na dogodku o lažnih novicah, ki so ga organizirali sami, ko niso znali zadovoljivo odgovoriti na vprašanje, zakaj v boju proti lažnim novicam objavljanja na družbenem omrežju ne prepovedo zloglasnemu profilu Infowars.

Infowars je skrajno desničarska spletna stran ameriškega radijskega voditelja Alexa Jonesa, katere profil na Facebooku ima skoraj milijon sledilcev, znana pa je po objavljanju številnih teorij zarot, ki temeljijo na prirejenih in povsem izmišljenih dejstvih ter tudi po razpihovanju sovraštva proti etničnim manjšinam.

Infowars je skrajno desničarska spletna stran ameriškega radijskega voditelja Alexa Jonesa, katere profil na Facebooku ima skoraj milijon sledilcev, znana pa je po objavljanju številnih teorij zarot, ki temeljijo na prirejenih in povsem izmišljenih dejstvih ter tudi po razpihovanju sovraštva proti etničnim manjšinam.

Pri Facebooku so se na vprašanje odzvali z zelo trhlim pojasnilom, da Infowars ne objavlja lažnih novic, temveč neresnične novice, kar pa ni ista stvar. Infowars je medtem med drugim trdil, da so napad na Svetovni trgovinski center 11. septembra 2001 organizirali Američani sami in da se streljanje v vrtcu v kraju Sandy Hook leta 2012, ko je umrlo 20 otrok, starih od 6 do 7 let, ni nikoli zgodilo.

Preberite tudi:

3